Tính năng nhận dạng khuôn mặt đang dần thâm nhập vào nhiều lĩnh vực trong cuộc sống, khi gương mặt có thể dùng để đăng nhập điện thoại hoặc máy tính, xác thực thanh toán, đi qua cổng kiểm soát tại sân bay và thậm chí được một số nơi thử nghiệm như công cụ giám sát.

Tuy nhiên, theo ghi nhận từ trang The Verge, công nghệ này đang gặp phải một vấn đề nghiêm trọng là sự thiên vị, khi tính chính xác bị ảnh hưởng bởi độ tuổi, giới tính và sắc tộc của đối tượng. Đồng thời, nhiều chuyên gia trong ngành còn cho rằng, các công ty cung cấp công nghệ chưa có những nỗ lực đáng kể để cải thiện tình hình.

Phụ nữ và người da màu gặp bất lợi

Một nghiên cứu hồi tháng 2 do MIT Media Lab (thuộc Học viện công nghệ Massachusetts) thực hiện đã chỉ ra, các thuật toán nhận diện gương mặt do IBM, Microsoft và Face++ thiết kế có tỷ lệ lỗi khi phát hiện giới tính của phụ nữ da sậm cao hơn đến 35% so với nam giới da sáng hơn.

Sự thiên vị này có thể củng cố định kiến “trọng nam khinh nữ” trong xã hội, gây ra nhiều ảnh hưởng tiêu cực đến phụ nữ và người dân tộc thiểu số, thậm chí là loại họ ra khỏi cơ sở hạ tầng kỹ thuật số của thế giới.

Quá trình nhận diện đang diễn ra với sự thiên vị, nhưng tệ hơn, các công ty trong ngành công nghiệp chưa có kế hoạch khắc phục triệt để vấn đề này (và ngay cả khi họ có thực hiện thì cũng rất khó để đánh giá mức độ cải tiến). Đồng thời, một quy chuẩn cho phép công chúng theo dõi sự cải thiện độ chính xác chưa tồn tại.

Nhiều người tin rằng, đã đến lúc phải giới thiệu các tiêu chuẩn toàn ngành về sự thiên vị và độ chính xác của công nghệ nhận diện gương mặt bằng các bài kiểm tra đo lường xem thuật toán hoạt động như thế nào khi nhận diện đối tượng ở độ tuổi, giới tính và màu da khác nhau.

Những công ty đang làm gì?

The Verge đã liên hệ với hàng chục tổ chức kinh doanh công nghệ nhận diện gương mặt, nhận dạng và thuật toán phân tích. “Đã nhận thức vấn đề thiên vị trong hệ thống” và “đang cố gắng cải thiện” là câu trả lời của hầu hết công ty, nhưng không ai trong số họ chia sẻ dữ liệu và số liệu chi tiết.

Một thương hiệu lớn là Microsoft cho biết họ đã cải tiến phần mềm nhận diện giới tính để giảm tỷ lệ lỗi từ 20.8% xuống còn 1.9% khi áp dụng cho phụ nữ da sẫm màu.

Trong khi đó, một số doanh nghiệp không đưa ra bất kỳ phản hồi nào khi được tiếp cận. Những đơn vị khác thì thừa nhận sự thiên vị là khó tránh khỏi khi không thể thu thập đủ dữ liệu chính xác và đề xuất phương án đào tạo thuật toán trên nguồn dữ liệu đa dạng hơn.

Làm thế nào để khắc phục vấn đề?

Giải pháp mà hầu hết chuyên gia đề xuất khá đơn giản về mặt khái niệm, nhưng khó thực hiện trong thực tế: Tạo thử nghiệm toàn ngành cho độ chính xác và sự thiên vị.

Một thử nghiệm như vậy đã tồn tại, được gọi là Face Recognition Vendor Test (FRVT), quản lý bởi Viện Tiêu chuẩn và Công nghệ Quốc Gia Mỹ (NIST). Nó kiểm tra tính chính xác của hàng chục hệ thống nhận diện khuôn mặt trong các kịch bản khác nhau (khớp ảnh hộ chiếu với người đang ở cửa khẩu, kết hợp khuôn mặt từ camera an ninh với ảnh chụp trong cơ sở dữ liệu…)

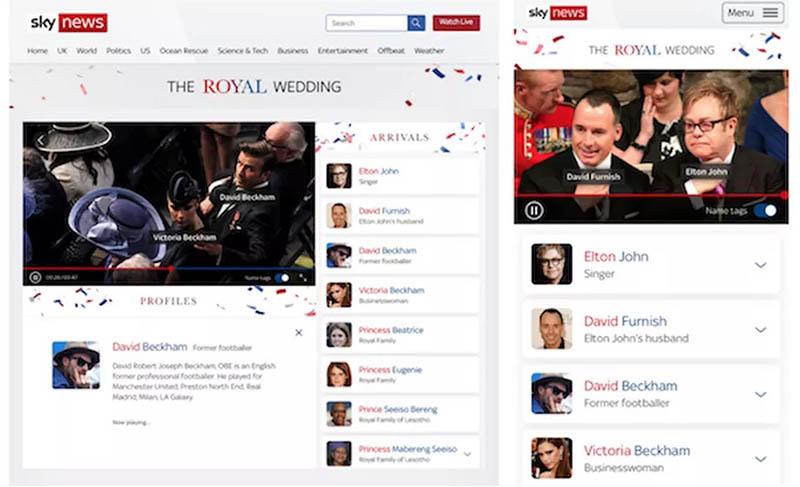

Đài truyền hình Sky sử dụng công nghệ nhận diện gương mặt của Amazon để có thông tin về người nổi tiếng đến tham dự đám cưới hoàng gia Anh

Mở rộng phạm vi tiếp cận của FRVT là một giải pháp hữu ích, nhưng khó thực hiện bởi nguồn lực hạn chế. Một thách thức nữa là thuật toán học sâu của những công ty lớn như Amazon hay Microsoft không thể dễ dàng gửi để phân tích, bởi chúng là một khối phần mềm khổng lồ được cập nhật liên tục.

Khi NIST bắt đầu kiểm tra, lỗi có giảm đáng kể nhưng vẫn còn sự khác biệt lớn giữa hiệu suất của các thuật toán khác nhau. “Không phải ai cũng có thể nhận diện gương mặt, nhưng nhiều công ty nghĩ rằng họ đủ khả năng để làm”, ông Patrick Grother - Trưởng nhóm tiêu chuẩn và kiểm tra sinh trắc học tại NIST chia sẻ.

Sự thiên vị không phải vấn đề duy nhất

Cuộc thảo luận dẫn đến những câu hỏi quan trọng khác về cách xã hội sử dụng công nghệ nhận diện khuôn mặt: Tại sao phải lo lắng về độ chính xác của công cụ này khi vấn đề lớn hơn là liệu chúng có được chính phủ sử dụng để giám sát?

Camera nhận diện gương mặt đã được trang bị tại sân bay

Joy Buolamwini, một nhà khoa học về AI (trí tuệ nhân tạo) nhận định: Chỉ đơn thuần cải thiện sự thiên vị là không đủ. Theo ông, cần phải có cách tiếp cận toàn diện hơn để xử lý các vấn đề liên quan đến công nghệ phân tích khuôn mặt như một vấn đề xã hội học. Những cân nhắc về mặt kỹ thuật không thể tách rời tác động đến xã hội.

Ví dụ, Brian Brackeen, CEO hãng Kairos tuyên bố: Công ty của ông sẽ không bán hệ thống nhận diện khuôn mặt cho cơ quan thực thi pháp luật vì e ngại sự lạm dụng.

Cần biết rằng, các cơ quan liên bang có quyền truy cập vào nhiều dữ liệu hơn, làm tăng khả năng hệ thống nhận diện khuôn mặt được sử dụng vào mục đích giám sát. Cùng với đó, quyết định của chính phủ trong việc sử dụng thuật toán sẽ tác động lớn đến đời sống cá nhân của công dân.

Cảnh sát Trung Quốc dùng kính tích hợp công nghệ nhận diện gương mặt để nhận biết tội phạm

Mặt khác, cơ quan hành pháp không chỉ sử dụng camera trên đường phố mà cả camera gắn trên thân người, ảnh căn cước, bản danh sách… Nếu sự thiên vị xảy ra ở bất kỳ trường hợp nào, rủi ro để một người da màu bị cáo buộc sai về việc phạm tội là không nhỏ.

Chốt lại vấn đề, Buolamwini cho rằng: Các tiêu chuẩn về độ chính xác là cần thiết, nhưng các công ty và nhà nghiên cứu công nghệ nhận diện gương mặt phải chịu trách nhiệm về việc đặt giới hạn ngữ cảnh cho những hệ thống mà họ phát triển nếu muốn giảm thiểu tác hại.

Tech Funny