Facebook có bảng hướng dẫn chi tiết cho nhân viên kiểm duyệt nội dung.

Báo cáo dựa vào tài liệu nội bộ công ty rò rỉ gồm các nguyên tắc và luật lệ mà Facebook hướng dẫn nhân viên kiểm duyệt. Chúng sẽ quyết định xem một bài viết có phải là nội dung thuộc các dạng bị cấm hay không, như bạo lực, phát ngôn gây thù hận, ảnh khỏa thân, tự tử và khủng bố. Nó cho thấy nỗ lực của Facebook trong việc loại bỏ nội dung độc hại nhưng vẫn đảm bảo quyền tự do ngôn luận.

The Guardian cho biết các tài liệu đã được “gửi đến những người kiểm duyệt của Facebook trong năm qua”. Facebook chưa xác nhận thông tin nhưng cũng không đưa ra bất kỳ bình luận phản bác nào.

“Chúng tôi làm việc chăm chỉ để tạo môi trường Facebook an toàn nhất có thể mà không ảnh hưởng tới quyền tự do ngôn luận”, Monika Bickert, Giám đốc quản lý chính sách toàn cầu công ty chia sẻ. “Điều này đòi hỏi chúng tôi phải nghiêm túc suy xét kỹ lưỡng từng vướng mắc cụ thể và vấn đề nổi cộm, rồi đưa ra giải pháp đúng đắn nhất”.

CEO Mark Zuckerberg hồi đầu tháng này đã thông báo công ty đang thuê 3.000 nhân viên để giúp “kiểm tra hàng triệu báo cáo mà chúng tôi nhận được mỗi tuần”.

Dưới đây là những điểm chính đáng chú ý từ phát hiện của The Guardian:

Các mối đe dọa lãnh đạo quốc gia là hành động không được chấp nhận

Tài liệu hướng dẫn người kiểm duyệt Facebook xóa tất cả những lời lẽ kiểu như “Hãy bắn *một vị lãnh đạo nào đó đi” bởi họ là đối tượng được bảo vệ đặc biệt. Còn nội dung kiểu 'Đánh hắn đi', 'Cho hắn một trận đi' có thể không bị xóa bỏ bởi được cho là chưa đến mức nguy hại.

Theo bảng hướng dẫn, các video bạo lực chết người không phải lúc nào cũng bị gỡ xuống bởi một số có thể góp phần tạo ra nhận thức về các vấn đề xã hội như bệnh tâm thần hoặc tội ác chiến tranh. Nội dung như vậy sẽ được đánh dấu với lời cảnh báo chứa hình ảnh gây shock và ẩn với người dùng trẻ vị thành niên.

Facebook cho phép cảnh Livestream tự làm hại bản thân

Facebook cho phép một ai đó livestream tự làm đau bản thân hoặc cố gắng để tự tử, bởi công ty không muốn kiểm duyệt hoặc gây khó dễ với những người đang ở trạng thái căng thẳng. Nếu họ không được giúp đỡ, nội dung sẽ được gỡ xuống, trừ phi nó trở thành đề tài có giá trị cảnh tỉnh xã hội.

Nhân viên giám sát được hướng dẫn nên bỏ kiểm duyệt các nội dung đe dọa tự tử được biểu hiện bằng hashtag, biểu tượng cảm xúc hoặc loại hình không mấy khả thi để thực hiện.

Livestream trở thành tính năng được nhiều người dùng Facebook ưa chuộng.

Trước đây, Facebook đã rất nỗ lực để phát hiện sớm tình trạng chán nản của người dùng có thể dẫn đến tự tử. Vào tháng 3, hãng tuyên bố đang thử nghiệm thuật toán trí thông minh nhân tạo để xác định các bài viết mang biểu hiện tự sát hoặc làm hại mình. Nó dựa vào những phản hồi của người dùng về những phát ngôn, tin nhắn hay dòng trạng thái tiêu cực được gắn cờ trước đó.

Facebook trả lời đài CNN cho biết công ty đang nỗ lực hoàn thiện công cụ để những người kiểm duyệt có thể dễ dàng liên hệ với cơ quan chức năng nhằm giúp đỡ ai đó khi thấy dấu hiệu bất thường.

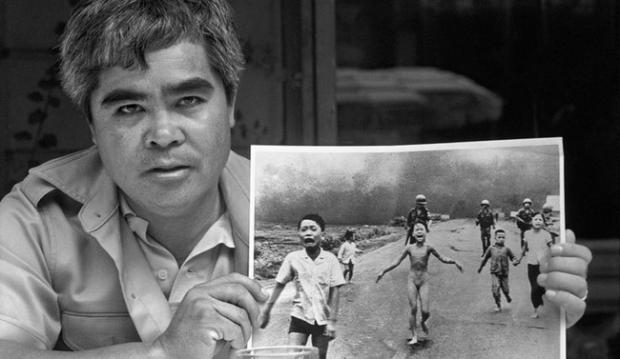

Nội dung khỏa thân

Facebook đã phải thay đổi chính sách kiểm duyệt nội dung khỏa thân sau khi bị cộng đồng chỉ trích nặng nề hồi tháng 9 năm ngoái với việc xóa bức ảnh nổi tiếng “Em bé Napalm” trong chiến tranh Việt Nam với hình ảnh cô bé Phan Thị Kim Phúc không mặc gì. Giờ đây, nội dung như vậy được chấp nhận.

Những bức ảnh như 'Em bé Napalm' được phép đăng lên Facebook.

Tuy nhiên, những bức ảnh trẻ em khỏa thân trong thảm họa Holocaust (thảm họa giết người Do Thái của Đức Quốc Xã) lại không được phép đăng tải.

Ngoài ra, bản tài liệu quy định, ảnh nghệ thuật vẽ bằng tay miêu tả hoạt động tình dục và khỏa thân được chấp nhận, nhưng nội dung nghệ thuật kỹ thuật số về chủ đề tương tự lại bị cấm.

Hãng cũng mạnh tay với loại hình khiêu dâm trả thù tình, như việc chia sẻ ảnh khỏa thân hoặc gần như khỏa thân của người khác mà khiến nạn nhân tổn thương.

Le Min Kop

Theo Trí Thức Trẻ/GenK